Transformeur génératif pré-entraîné

Un transformeur génératif pré-entraîné (ou GPT, de l’anglais generative pre-trained transformer) est un type de grand modèle de langage basé sur l'architecture transformeur. Le « pré-entraînement » consiste à prédire le prochain mot dans une séquence de texte. Répété pour de vastes corpus de données textuelles, cet entraînement permet ensuite au modèle de générer du texte semblable.

Description[modifier | modifier le code]

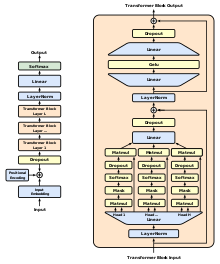

Il est construit en utilisant plusieurs blocs de la partie décodeur de l'architecture du transformeur. Ils peuvent être affinés pour diverses tâches de traitement du langage naturel telles que la génération de texte, la traduction de langue et la classification de texte. Le « pré-entraînement » dans son nom fait référence au processus de formation initial sur un grand corpus de texte où le modèle apprend à prédire le mot suivant dans un passage, ce qui fournit une base solide pour que le modèle fonctionne bien sur des tâches en aval avec des quantités limitées de données spécifiques à la tâche.

Exemples d'utilisation[modifier | modifier le code]

- ChatGPT (Chat Generative Pre-trained Transformer[1]) est un chatbot lancé par OpenAI en novembre 2022. Il utilise GPT-3.5 et GPT-4 et est affiné (une approche de l'apprentissage par transfert[2]) avec des techniques d'apprentissage supervisé et par renforcement.

- BioGPT est un GPT qui se concentre sur la réponse aux questions biomédicales[3]. Il est développé par Microsoft[4].

- ProtGPT2 est un GPT qui se concentre sur la conception de protéines[5].

Historique[modifier | modifier le code]

Les performances des modèles GPT reposent à la fois sur l'architecture transformeur, et sur une nouvelle méthode d'apprentissage ne nécessitant pas l'annotation des données d'entraînement.

Jusqu'en 2017, les réseaux de neurones les plus performants en traitement automatique des langues (les LSTM) utilisaient principalement l'apprentissage supervisé à partir de données étiquetées manuellement. L'annotation de grands ensembles de données rendait l'entraînement de ces modèles coûteux et chronophage[6],[7]. De plus, de nombreuses langues (telles que le swahili ou le créole haïtien ) étaient difficiles à traduire et à interpréter à l'aide de tels modèles en raison d'un manque de traductions existantes pour entraîner le modèle[7].

La publication par des chercheurs de Google d'un article intitulé Attention Is All You Need[8] conduit à l’émergence de grands modèles de langage tels que BERT en octobre 2018[9], qui est un transformeur pré-entraîné non génératif. A la même période, le 11 juin 2018, OpenAI publie un article intitulé Improving Language Understanding by Generative Pre-Training, dans lequel est introduit le premier Generative Pre-trained Transformer (« GPT-1 »)[6].

L'apprentissage auto-supervisé utilisé par OpenAI pour entraîner ses grands modèles de langage commence par une étape de « pré-entraînement », où le modèle est entraîné à prédire le token suivant (un token étant une séquence de caractères, typiquement un mot, une partie d'un mot, ou de la ponctuation). Cet entraînement à prédire ce qui va suivre, répété pour un grand nombre de textes, permet à ces modèles d'accumuler des connaissances sur le monde[6],[10].

Il y a ensuite parfois une étape d'apprentissage supervisé où le modèle est ajusté pour une tâche donnée[6], par exemple pour obtenir des réponses selon un format ou un style d'assistant. Il y a également souvent une étape d'apprentissage par renforcement (telle que RLHF ou RLAIF) permettant de rendre le modèle plus véridique, utile et inoffensif[10],[11].

| Version | Architecture | Nombre de paramètres | Données d'entraînement |

|---|---|---|---|

| GPT-1 | Transformeur de type decodeur à 12 niveaux et 12 têtes (pas d'encodeur), suivi de linear-softmax. | 0,12 × 109 | BookCorpus[12] : 4,5 Go de texte, à partir de 7 000 livres inédits de divers genres. |

| GPT-2 | GPT-1, mais avec une normalisation modifiée | 1,5 × 109 | WebText : 40 Go de texte, 8 millions de documents, à partir de 45 millions de pages Web votées sur Reddit. |

| GPT-3 | GPT-2, mais avec des modifications pour permettre une plus grande mise à l'échelle. | 175 × 109 | 570 Go de texte en clair, 0,4 billion de jetons. Principalement CommonCrawl, WebText, Wikipedia anglais et deux corpus de livres (Books1 et Books2). |

Références[modifier | modifier le code]

- (en) Cet article est partiellement ou en totalité issu de l’article de Wikipédia en anglais intitulé « Generative pre-trained transformer » (voir la liste des auteurs).

- (en-US) Kevin Roose, « The Brilliance and Weirdness of ChatGPT » [archive du ], The New York Times, (consulté le ) : « Like those tools, ChatGPT — which stands for generative pre-trained transformer — landed with a splash. »

- Joanne Quinn, Dive into deep learning: tools for engagement, Thousand Oaks, California, (ISBN 9781544361376, lire en ligne [archive du ]), p. 551

- (en) Luo R, Sun L, Xia Y, Qin T, Zhang S, Poon H, « BioGPT: generative pre-trained transformer for biomedical text generation and mining. », Brief Bioinform, vol. 23, no 6, (PMID 36156661, DOI 10.1093/bib/bbac409, lire en ligne)

- (en) Matthias Bastian, « BioGPT is a Microsoft language model trained for biomedical tasks », The Decoder,

- (en) Ferruz, N., Schmidt, S. & Höcker, B., « ProtGPT2 is a deep unsupervised language model for protein design. », Nature Communications volume, vol. 13, (DOI 10.1038/s41467-022-32007-7, lire en ligne)

- (en) Alec Radford, Karthik Narasimhan, Tim Salimans et Ilya Sutskever, « Improving Language Understanding by Generative Pre-Training » [archive du ], OpenAI, (consulté le ), p. 12

- (en) Yulia Tsvetkov, « Opportunities and Challenges in Working with Low-Resource Languages » [archive du ], Carnegie Mellon University, (consulté le )

- Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N Gomez, Łukasz Kaiser et Illia Polosukhin, « Attention is All you Need », Curran Associates, Inc., vol. 30, (lire en ligne)

- Jacob Devlin, Ming-Wei Chang, Kenton Lee et Kristina Toutanova, « BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding », Association for Computational Linguistics, (arXiv 1810.04805v2)

- (en) Craig S. Smith, « ChatGPT-4 Creator Ilya Sutskever on AI Hallucinations and AI Democracy », sur Forbes (consulté le )

- (en) Sujatha Sagiraju Appen, « How reinforcement learning with human feedback is unlocking the power of generative AI », sur VentureBeat, (consulté le )

- (en) Yukun Zhu, Ryan Kiros, Rich Zemel et Ruslan Salakhutdinov, « Aligning Books and Movies: Towards Story-Like Visual Explanations by Watching Movies and Reading Books », IEEE International Conference on Computer Vision, , p. 19–27 (lire en ligne)